One more thing: Apples Einstieg in Mixed Reality mit neuer “Vision Pro” Brille

Apple hat auf seiner diesjährigen Entwicklerkonferenz seine erste Mixed Reality Brille mit dem Namen „Vision Pro“ vorgestellt. Im Vorfeld wurde bereits seit längerer Zeit spekuliert, dass Apple den Einstieg in diesen Anwendungsbereich mit einer eigenen neuen Geräteklasse bekannt gibt. Apple nennt den Bereich „Spatial Computing“ und platziert das Gerät damit in einem ähnlichen Umfeld wie die „Mixed Reality“-Hardware anderer Hersteller. Im Vordergrund steht dabei die dreidimensionale Darstellung von virtuellen Objekten, um die reale Umgebung mit eingeblendeten Elementen zu erweitern.

Apple Vision Pro Headset | Quelle: © Apple

Der Weg zur erweiterten Realität: Transparenz vs. Videobild

Die Darstellung der 3D-Inhalte vor einem realen Hintergrund mithilfe eines HMD (Head-Mounted Display) lässt sich mit zwei unterschiedlichen Prinzipien realisieren. Die „Vision Pro“ Brille von Apple basiert auf dem Video-Pass-Through Ansatz. Im Gegensatz zu Mixed Reality Headsets wie HoloLens oder Magic Leap, kommt dabei kein transparentes Display-System zum Einsatz. Der gelichzeitige Blick auf reale Umgebung und virtuelle Objekte wird bei dieser Technik durch den Einsatz mehrerer Kameras ermöglicht. Das Umfeld des Trägers wird dabei aufgezeichnet und auf den Displays der Brille zusammen mit den virtuellen 3D-Elementen angezeigt. Während Geräte wie die HoloLens eine transparente Optik mit Lichtwellenleitern zur Überlagerung der sichtbaren Umgebung einsetzen, hat die „Vision Pro“ einen ähnlichen Grundaufbau wie VR-Headsets. Zusätzlich werden aber Augmented Reality Funktionen durch eingeblendete Inhalte in den Videobildern bereitgestellt. Dieser Ansatz bietet deshalb die Möglichkeit zwischen reiner VR- und AR-Nutzung umzuschalten. Apple stattet die Brille mit einem Drehregler aus, der es erlaubt die Sichtbarkeit der realen Umgebung zu steuern.

Apple Vision Pro – Headset mit Videodurchsicht | Quelle: © Apple

Microsoft HoloLens – Headset mit transparentem Display | Quelle: © Microsoft

Licht und Schatten: Vor- und Nachteile der beiden Systeme

Prinzipiell bieten transparente See-Through-Geräte und kamerabasierte Pass-Through-Brillen unterschiedliche Vor- und Nachteile. Die Stärken und Schwächen hängen von der jeweiligen Technologie und dem gewünschten Einsatzgebiet ab. Neben der Möglichkeit komplette VR-Umgebungen darzustellen, gehört eine geringere Abhängigkeit von den Lichtverhältnissen zu den Vorteilen der „Vision Pro“. Die Qualität und Sichtbarkeit der 3D-Darstellungen wird nicht durch die Helligkeit der Umgebung beeinträchtigt und es ist möglich komplett undurchsichtige 3D-Elemente anzuzeigen. Problematischer als bei transparenten Displaysystemen ist hingegen die Latenz bei der Darstellung der Umgebung und die räumliche Wirkung der Videodurchsicht. Außerdem ist der Träger des Geräts durch die geschlossene Bauweise stärker von seinem Umfeld isoliert und es ist schwieriger sich während der Nutzung mit anderen Personen in der Umgebung zu unterhalten. Apple versucht dem entgegenzuwirken, indem die Augen des Benutzers auf die Außenseite der Brille übertragen werden.

EyeSight – Anzeige der Augen auf Außendisplay | Quelle: © Apple

Spatial Computing: Interaktive räumliche Anwendungen

Die Steuerung und Bedienkonzepte für Mixed Reality Anwendungen lassen sich auf der „Vision Pro“ Brille ähnlich wie auf anderen Headsets umsetzen. Die Eingabe erfolgt hauptsächlich über Handtracking und Gestensteuerung oder per Spracherkennung. Zusätzliche Möglichkeiten stellt die Apple Brille im Bereich der Aufnahmemöglichkeiten zur Verfügung. Die Sensoren und Kameras ermöglichen das Erstellen von stereoskopischen Fotos und Videos. Bei der Wiedergabe von Mulimedia-Inhalten profitiert das Gerät von der hohen Auflösung und Displayqualität, was auch Anwendungen im Bereich Home-Entertainment ermöglichen soll. Beim visionOS genannten Betriebssystem der Brille kann Apple auf bereits bestehende Kernfunktionen aus dem Bereich der mobilen Geräte zurückgreifen. Mit dem ARKit-Framework bietet Apple bereits seit längerer Zeit Augmented Reality Funktionen für iPhone Apps. Diese Technologien wurden in das Betriebssystem der „Vision Pro“ Brille integriert, was die Ausführung von bestehenden Anwendungen als virtuelles 2D-Fenster auf der Brille ermöglicht.

Darstellung von Panorama-Aufnahmen auf der Vision Pro | Quelle: © Apple

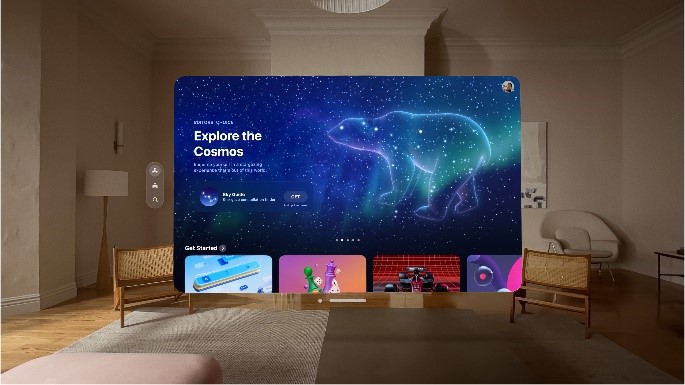

Anwendung im virtuellen 2D-Fenster | Quelle: © Apple

Neue Erlebnisse: Entwicklung von „Vision Pro“ Anwendungen

Die Softwareentwicklung für die Vision Pro erfolgt mit den bisherigen Apple-Werkzeugen, die um zusätzliche Tools für die dreidimensionale Gestaltung erweitert wurden. Zusätzlich wird auch die Entwicklung mithilfe der Unity Engine unterstützt, um komplexere 3D-Anwendungen zu erstellen. Die benötigten Frameworks werden Apple-Entwicklern in Kürze zur Verfügung gestellt, um mit der Erstellung eigener Anwendungen für die „Vision Pro“-Brille beginnen zu können. Der Marktstart der Geräte ist für Anfang 2024 geplant. Apples erstes Headset erscheint dann zu einem Preis von 3499 US-Dollar und soll laut den Aussagen bei der Entwicklerkonferenz den Start in die neue Zeit räumlicher Softwareanwendungen darstellen, die Ära des „Spatial Computing“.

Spatial Computing Anwendungen auf dem Vision Pro Headset | Quelle: © Apple